安装ollama

linux环境安装ollama文档

https://github.com/ollama/ollama/blob/main/docs/linux.md

安装包:https://ollama.com/download/ollama-linux-amd64.tgz

sudo tar -C /usr -xzf ollama-linux-amd64.tgz

配置systemctl

vi /etc/systemd/system/ollama.service

[Unit]

Description=Ollama Service

After=network-online.target

[Service]

ExecStart=/usr/bin/ollama serve

User=root

Group=root

Restart=always

RestartSec=3

Environment="PATH=$PATH"

Environment="OLLAMA_HOST=0.0.0.0"

[Install]

WantedBy=default.target

sudo systemctl daemon-reload

sudo systemctl enable ollama

安装deepseek

https://ollama.com/library/deepseek-r1

选择自己合适的模型

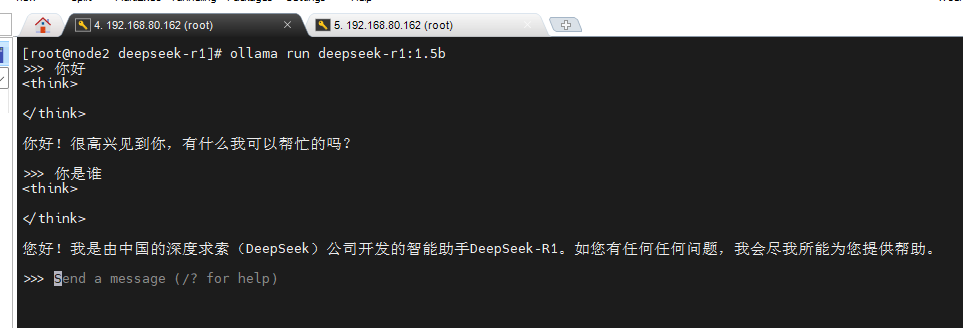

ollama run deepseek-r1:1.5b

模型越大下的越久,占的内存和大小也越大

下载完之后就可以正常在命令行里面使用了

使用其他第三方工具

如果只是在命令行里面用,那就不太好用了

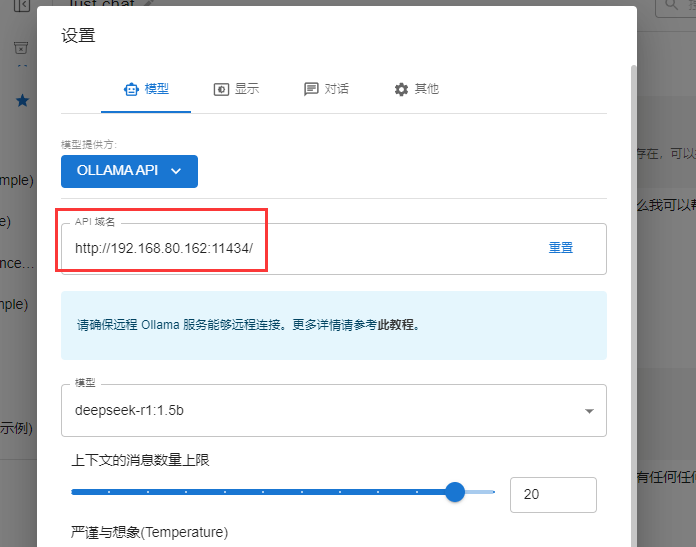

可以使用chatbox这个工具,然后配置一下api,就可以直接在客户端上使用了

需要确定一下,你的服务器有没有开放11434端口,如果没开的话开一下

firewall-cmd --zone=public --add-port=11434/tcp --permanent

firewall-cmd --reload

firewall-cmd --zone=public --list-ports

然后就可以愉快的使用了

当然,如果你服务器配置强劲,还可以直接使用满血版deepseek